这是深度学习专项课程第一课第三周的编程作业,通过这次编程作业,可以学到:

- 用一个单隐层神经网络实现一个二元分类器

- 使用非线性的激活函数

- 计算交叉熵损失

- 实现前向和后向传播

包的引入

1 | # 引入包 |

这是深度学习专项课程第一课第三周的编程作业,通过这次编程作业,可以学到:

1 | # 引入包 |

本周主要介绍单隐层神经网络 (one hidden layer Neural Network)。

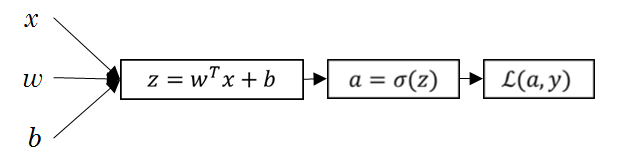

逻辑回归的计算图如下,这是一个最小的神经网络:

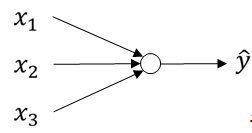

堆叠一系列的 $\sigma$ 单元,构建一个单隐层神经网络:

Numpy 是 Python 里用于科学计算的模块,由一个开源社区进行维护,下面介绍一些用于神经网络搭建的函数的构建

回忆:$sigmoid(x)=\frac {1}{1+e^{-x}}$

如果 $ x = (x_1, x_2, …, x_n)$ 是一个行向量,那么 $np.exp(x)$ 会将 $exp( )$ 函数用于 x 的每个元素,输出 $np.exp(x) = (e^{x_1}, e^{x_2}, …, e^{x_n})$

1 | import numpy as np |

>> [ 2.71828183 7.3890561 20.08553692]

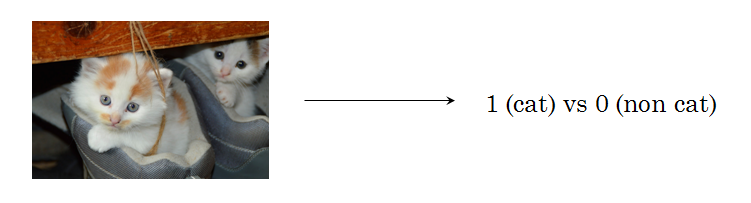

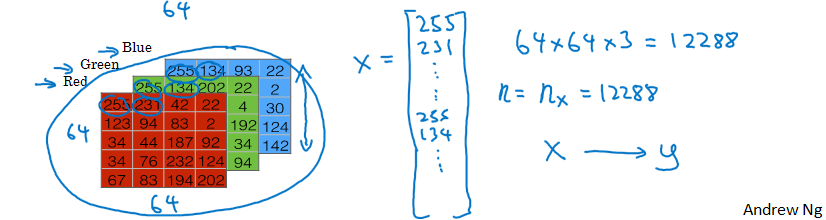

本周主要介绍逻辑回归算法 (Logistics Regression)。

输出值为离散的两个值,即 1 或者 0

本周主要介绍深度学习的概况。

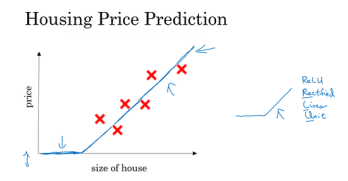

预测房价(线性回归问题):

这是我的博客的第一篇文章,我想在这篇文章里记录一下自己搭建这个博客的全过程和途中踩过的坑,一是为了记录一下,二是方便以后换电脑需要再次搭建的时候有个参考,如果能帮助到其他人就更好了。

前段时间刚开始自学python和机器学习,为了找到最佳的笔记方案,我上知乎搜“学习编程怎么做笔记?”有的人说不用做笔记,有的人说用 gitbook,有的人说直接记在代码注释里,有的人说直接记在 github 的 wiki 或者 issue 页面。但是还看到许多人推荐记录在自己的独立博客上,作为一个一直希望有自己博客的人,我立马萌生了自己搭博客的想法,但是碍于麻烦一直有些动摇,直到这篇文章《为什么你要写博客?》打动了我,它让我下定决心搭建自己的博客并坚持写点东西,不仅可以放自己学习过程中的笔记,作为一个话痨,还可以放一些自己的随想和读书笔记,何乐而不为?

总的来说,我认为写博客能给我以下的好处:

那么废话不多说,直接开始吧!